Découvrez le protocole Model Context, son architecture technique, ses cas d'utilisation concrets et comment l'implémenter pour connecter vos modèles de langage LLM à vos sources de données et à vos outils externes.

Lancé par Anthropic fin 2024, ce protocole open source s'est imposé en 2025 comme le standard d'interopérabilité des agents IA. Aujourd'hui adopté par OpenAI, Microsoft, JetBrains et des milliers de développeurs dans le monde.

Le Model Context Protocol : définition et enjeux

Le Model Context Protocol (MCP) est une norme ouverte. Elle permet aux applications d'intelligence artificielle, notamment les modèles de langage LLM, de se connecter de manière sécurisée et bidirectionnelle à diverses sources de données et à des outils externes. En standardisant ces interactions, le MCP facilite l'intégration et l'interopérabilité entre les modèles d'IA et les systèmes existants.

MCP est un protocole pensé comme l'USB-C des applications IA : un connecteur universel, quel que soit le service externe ou le système de fichiers à brancher.

Concrètement, MCP repose sur une relation entre clients MCP (l'application IA, l'assistant IA ou l'IDE) et des serveurs MCP (les programmes qui exposent les données ou les outils).

Cette architecture client-serveur standardisée permet à un même modèle de requêter une base de données, un dépôt Git ou un outil de surveillance sans développement ad hoc.

En mars 2025, OpenAI a officiellement adopté MCP dans son SDK Agents et ses outils de développement, signalant que le protocole dépassait l'écosystème Anthropic pour devenir un standard de facto de l'industrie IA. (Source : OpenAI, "Nouveaux outils pour les agents de construction", 26 mars 2025 - openai.com/index/new-tools-for-building-agents )

À retenir : le model context protocol MCP est un protocole open source lancé fin 2024, qui standardise la communication entre les LLM et les données externes. Son adoption par OpenAI en mars 2025 en a fait un standard d'industrie en moins de six mois.

Serveurs MCP existants : un écosystème en croissance rapide

Dans un an, l'écosystème MCP a connu une croissance remarquable. Le dépôt officiel GitHub modelcontextprotocol/servers référence aujourd'hui plus de 1 000 serveurs MCP publiés par la communauté, couvrant des dizaines de catégories d'outils et de sources de données. (Source : GitHub, modelcontextprotocol/servers, consulté mars 2026 — github.com/modelcontextprotocol/servers )

Quelques exemples notables parmi les serveurs MCP les plus utilisés :

- Git : accès aux dépôts, lecture, recherche et manipulation de fichiers, utile pour l'analyse de code ou la génération de documentation.

- PostgreSQL : inspection des schémas et exécution de requêtes en lecture seule.

- Redis : interaction avec des bases en mémoire pour stocker et récupérer des données rapidement.

- Slack : intégration aux canaux de communication pour des interactions en temps réel — réponses à des messages, résumés de conversations.

- Sentry : accès aux rapports d'erreurs et aux journaux pour diagnostiquer et résoudre des problèmes logiciels.

- Grafana : recherche dans les tableaux de bord et interrogation des sources de données de surveillance.

- MotherDuck : interrogation et analyse des données via DuckDB, particulièrement adapté aux workloads analytiques.

Du côté des clients MCP , l'adoption s'est également accélérée. En 2025, VS Code (Microsoft) , JetBrains , Cursor , Zed et Sourcegraph Cody ont tous annoncé un support natif de MCP. Claude Desktop reste la référence pour les utilisateurs non-développeurs souhaitant connecter des outils locaux sans écrire de code. (Source : documentation officielle MCP, modelcontextprotocol.io, 2025)

À retenir : l'écosystème MCP dépasse les 1 000 serveurs référencés début 2026. Les principaux éditeurs d'IDE et de plateformes IA ont intégré nativement le protocole, ce qui en fait aujourd'hui un standard opérationnel et non plus expérimental.

Détails techniques du protocole MCP

MCP suit une architecture client-serveur similaire au Language Server Protocol (LSP). Voici les principaux aspects techniques :

Architecture Le client est généralement une application IA, un assistant IA ou un environnement de développement. Le serveur est un programme qui fournit l'accès à des données ou des outils spécifiques, fichiers locaux, base de données, service externe, API tierce.

Communication Les requêtes et réponses sont encodées selon la spécification JSON-RPC 2.0 . La communication entre les clients et les serveurs se fait via stdin/stdout (pour les processus locaux) ou HTTP avec Server-Sent Events (pour les déploiements distants).

Évolution de la spécification La spécification MCP a évolué depuis son lancement. La version 2025-03-26, publiée en mars 2025, introduit notamment le support d' OAuth 2.1 pour l'authentification sécurisée des serveurs MCP distants, un prérequis pour les déploiements en environnement d'entreprise. (Source : Spécification du protocole de contexte de modèle, spec.modelcontextprotocol.io, version 2025-03-26)

SDKs officiels Des kits de développement sont disponibles en Python , TypeScript, Java et Kotlin , ce qui couvre la majorité des environnements d'entreprise.

À retenir : MCP est un protocole ouvert, documenté et activement maintenu. L'ajout d'OAuth 2.1 dans la spec 2025-03-26 lève le principal frein à son adoption en entreprise : la sécurisation des connexions aux serveurs distants.

Cas d'utilisation : interroger une base PostgreSQL via MCP depuis un chat métier

Objectif : permettre à un utilisateur métier, commercial, RH, logistique, de poser une question en langage naturel dans un chat et d'obtenir une réponse basée sur des données en temps réel issues d'une base PostgreSQL, grâce au Model Context Protocol .

Étapes du processus

- L'utilisateur saisit sa question dans l'interface de chat (ex. : "Quelles commandes sont en retard cette semaine ?" ).

- L'assistant IA transmet la requête au serveur MCP PostgreSQL.

- Le serveur MCP a traduit la requête en SQL et interroge la base en lecture seule.

- Le résultat est retourné au LLM, qui formule une réponse en langage naturel.

- L'utilisateur obtient une réponse contextualisée, sans accès direct à la base.

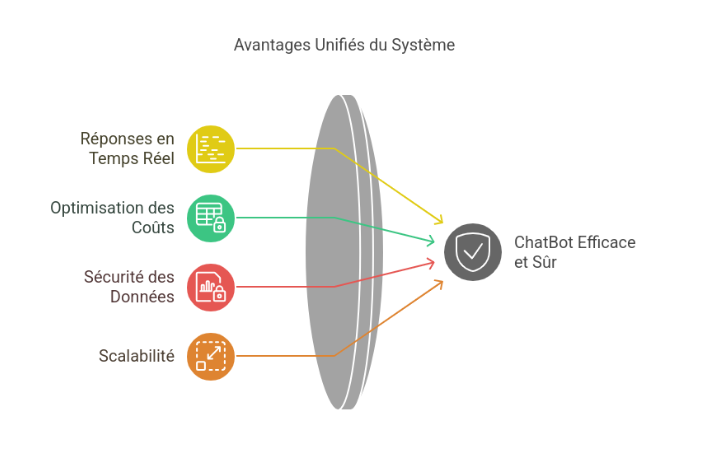

Avantages de cette approche

- Données en temps réel : pas besoin de réentraîner le modèle ni d'exporter des données.

- Optimisation des coûts : moins de contexte à injecter dans les invites.

- Sécurité : PostgreSQL protège les données sensibles via les permissions existantes ; l'ajout d'OAuth 2.1 dans la spec MCP renforce encore ce point pour les déploiements distants.

- Scalabilité : MCP permet d'ajouter d'autres bases ou API sans refonte de l'architecture.

À retenir : ce cas d'usage illustre comment des agents IA peuvent accéder à des données externes métier en temps réel, sans exposer les systèmes sous-jacents ni modifier les modèles. C'est précisément ce type d'architecture que les équipes informatiques privilégient en 2026 pour leurs projets d'IA générative en production.

Comment implémenter un serveur MCP ?

Voici les étapes pour déployer votre propre serveur MCP :

- Choisissez votre langage : Python et TypeScript sont les SDK les plus matures et les mieux documentés. Java et Kotlin sont disponibles pour les environnements d'entreprise.

- Utiliser le SDK officiel : il fournit les outils pour gérer les communications et les structures de données requises.

- Définir les capacités : quelles données ou actions votre serveur va-t-il exposer ? (lecture de fichiers locaux, requêtes SQL, appels API…)

- Implémenter les méthodes : développez chaque capacité en suivant la spécification MCP.

- Gérer la communication : assurez-vous que le serveur répond au format JSON-RPC 2.0 et supporte les transports requis (Stdio ou HTTP/SSE).

- Sécuriser l'accès : pour un déploiement distant, implémentez OAuth 2.1 conformément à la spécification version 2025-03-26.

- Testeur et déploiement : validez le comportement de votre serveur avant mise en production.

Un serveur MCP vous permettra de connecter vos sources de données, métier applicatif, base de données, systèmes de fichiers, à votre LLM de manière standardisée et sécurisée.

À retenir : l'implémentation d'un serveur MCP ne nécessite pas de compétences IA avancées. Les SDK disponibles en Python et TypeScript permettent de démarrer rapidement, même sur des environnements existants. L'ajout d'OAuth 2.1 dans la spec 2025 simplifie également la sécurisation des déploiements en production.